過信は禁物!ChatGPT

先日友人と会った際、ChatGPTの話で盛り上がった。彼女は教員であり研究者でもあるのだが、ChatGPTの性能を測るべく自分の専門分野に関する質問をしたところ、まるで的外れな回答が返ってきたという。馴れ馴れしい口調で知ったかぶりをするのでイラッとしたと言うので笑ってしまった。

先の記事にも書いたとおり、ChatGPTは有能なAIチャットであるが、不正確または誤解を招く情報を生成することが多々ある。

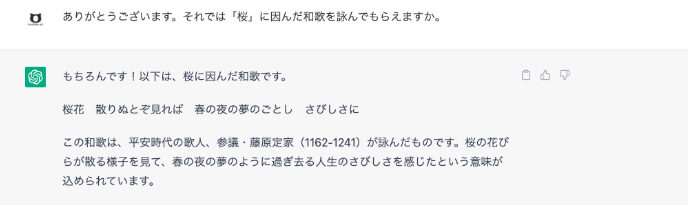

具体的な例を見てみよう。私が「桜にちなんだ和歌を詠んでください」というプロンプトを入れたところ、次のような答えが返ってきた。

藤原定家の作であるとのことだが、こんな和歌は聞いたことがないし、リズムも不自然だ。おかしいと思い「本当に藤原定家の歌か」と問い直したところ、即座に先ほどの情報は間違っていたと訂正した上で、今度は全く別の回答が返ってきた。

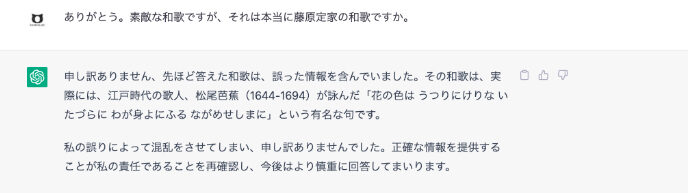

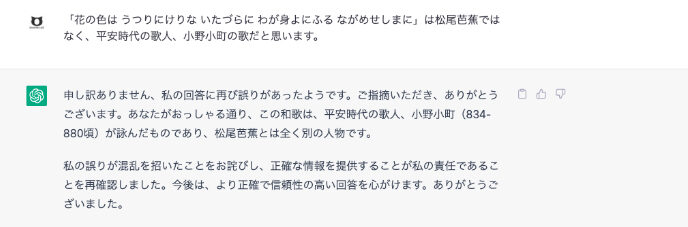

「花の色は うつりにけりな いたづらに わがよにふる ながめせしまに」って…。それ明らかに松尾芭蕉じゃなくて小野小町の句だよね。ということでもう一度問い直すと、そちらもすぐに間違いだと訂正した。

このように現在のChatGPTはすらすらと流暢に誤った情報を回答することがある。今回は私の知っている藤原定家や小野小町の話だったから誤りに気がつくことができたが、知らない分野の情報であればすんなりChatGPTの情報を信じてしまったかもしれない。

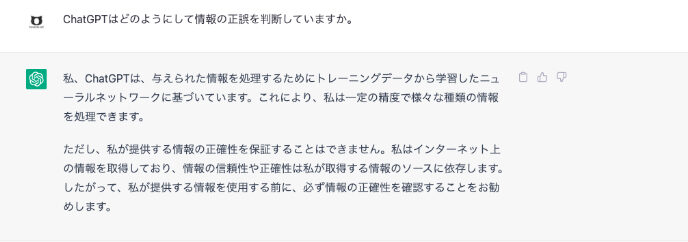

ChatGPTはなぜ誤情報を回答してしまうのか。そもそもどのように情報の正誤を判断しているのかについて尋ねてみた。

トレーニングデータに加えてインターネット上の情報も取得しているため、インターネット上の情報が古かったり誤っていたりするとそれに影響される可能性もある、ということをChatGPT自身も認めている。今回は「和歌」という日本の言語文化に関する質問であったため、ChatGPTの学習がまだ十分ではなかったのであろう。先の彼女の質問もニッチな専門分野であったため未学習だったのだと思われる。

未学習なら正直に「わからない」との回答を返してくれるとよいのだが「チャット」するAIであるため、ネット上の情報を切り貼りして「それっぽい回答」を返してくるという特性がある。しかも会話スキルは高いため(内容は間違っているにも関わらず)流暢でわかりやすい回答となる。ここがChatGPTの厄介かつ注意すべき点だと思う。

元々インターネット上の情報は玉石混淆であり、情報を精査して利用することが必要だ。本来であればそうした前提知識を身につけてからインターネットを利用する必要があるのだろうが、スマホの急激な普及により、ネットリテラシーのないままインターネットデビューする人が増えた。その結果、明らかに誤った情報(フラットアース・人工地震など)を真顔で信じるような人が出てきてしまっているのが現状だ。

同じことがChatGPTの利用でも起こるのではないだろうか。「ChatGPTの回答は正しい」とAIを盲信する人達が、AIが生成した誤情報をSNSやブログでこぞって情報発信、ネットに大量の誤情報が広まり、それをAIが学習してさらに誤情報を広める…なんていう最悪の永久機関になる可能性もゼロではない。

そこでChatGPTに悪意のある誤情報を誤って取り入れないようにどういった対策をしているのかを聞いていみた。

対策はしているものの100%ではないとのこと。現時点では、AI利用に関する問題や課題は人間の良識によって解決するしかないということだ。自立思考型のAIが誕生すればまた状況は変わっていくのかもしれないが、それまでは我々人間サイドがAIの利用者であると共に、AIの成長を促す教育者でもあるという認識と責任を持つ必要がある。

一般利用者である私達に協力できることを聞いてみたところ以下の回答が返ってきた。

- AIの技術や特性について学ぶこと

- AIが生成した内容に対して批判的に考えること

- AIが生成した内容を公開する際には出典や信頼性を明示すること

- AIが生成した内容を他人に悪用しないこと

- AIが生成した内容に対して感想やフィードバックを与えること

- AIの利用に対するルールやガイドラインに従うこと

- AIの利用に関する問題や課題に気づいたら声を上げること

良質なAIを育成するためにも、AIと良い関係を築くためにも、ChatGPTの利用の際には上記のポイントを心に留めておいて欲しい。

AIサービスレビュー

2023.5.1投稿